'Explainability is een farce'

Er is dus een verschil tussen opzettelijke bias en potentieel desastreuze onbedoelde bias. In beide gevallen moeten betrokkenen kunnen kijken wat er precies gebeurt in een AI-proces. Een bias moet immers eerst worden geïdentificeerd voordat bepaald kan worden of hij opzettelijk of onbedoeld aanwezig is.

Black box naar glass box

In de wereld van AI wordt daarom veelal het woord 'explainability' rondgeslingerd, dat vrij vertaald zoiets betekent als 'uitlegbaarheid'. Het idee is dat makers van een kunstmatige intelligentie geen 'black box' creëren, een ondoorzichtige zwarte doos waar van alles in gebeurt. Velen streven een 'glass box' na, waarbij ontwikkelaars precies kunnen zien wat er in de doos gebeurt.

Over de effectiviteit van een transparant AI-proces verschillen de meningen echter. Volgens Woods, die naast zijn werk bij Splunk als Fellow AI en Machinelearning bij het World Economic Forum de publieke sector adviseert op het gebruik van AI, is explainability een farce. "Je kunt simpele 'keuzes' van een algoritme nog uitleggen, maar het wordt al snel heel ingewikkeld."

Hij gaat verder: "Stel je voor: een enkele menselijke beslissing (bijvoorbeeld het kiezen van je favoriete kleur, red.) kun je makkelijk analyseren, maar honderdduizenden beslissingen niet. Hoe zou dat voor een algoritme dan moeten kunnen? Daarom worden de meeste details van de stappen van een algoritme niet gedocumenteerd; dat kost simpelweg te veel tijd en moeite, en het heeft dan geen waarneembare impact op het eindresultaat."

Wognum van BrainCreators ziet de controverse rondom explainability als een nondiscussie: "Wij kunnen stappen van de meest complexe AI's gewoon beschrijven, het is wiskunde." Hij vraagt zich daarentegen af in hoeverre het herkennen van de stappen nut heeft. "Een cpu is een verzameling transistoren. In hoeverre kunnen we dat uitleggen en echt begrijpen? Kijk naar de neurowetenschap; we weten tot op de dag van vandaag niet precies hoe het menselijk brein werkt." Wognum stelt dat het uitleggen van iedere stap niet nodig is wanneer het eindresultaat goed is.

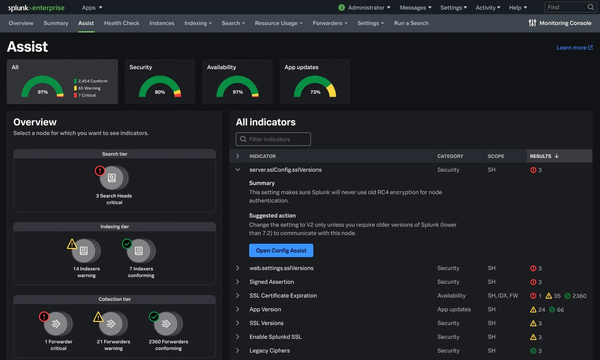

Afbeelding interface met data vergaard uit AI, via Splunk